三种开始拥有AI安全的方式 媒体

AI安全挑战与应对策略

关键要点

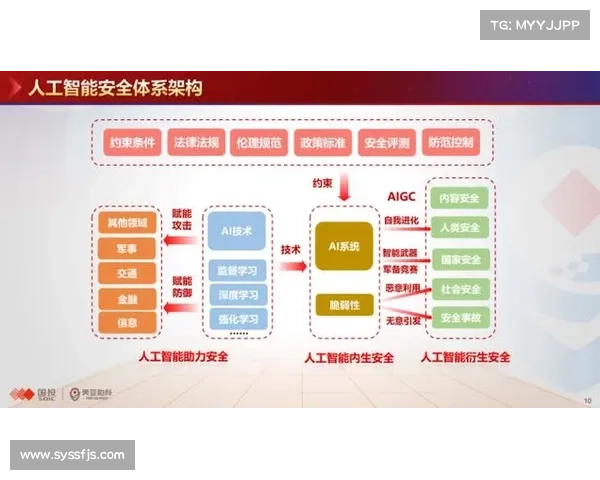

在过去一年中,安全领域面临了重大挑战,尤其是针对新兴的人工智能( AI )威胁。安全团队必须应对复杂的零日攻击和不断变化的法规要求。此外,组织被要求不仅保护自身,还要有效利用AI来增强安全性。本文将讨论当前AI安全面临的风险及应对措施,这些风险包括:数据训练中的隐私问题、对AI的过度信任以及恶意对手利用AI技术。为了有效管理这些风险,各部门间需要加强协作。

当前AI安全面临的风险

过去一年,安全领域遭遇了前所未有的挑战。在威胁方面,众多零日攻击事件让安全团队忙得不可开交。在法规方面,美国证券交易委员会SEC出台了更严格的事件报告要求,而欧盟也因AI威胁而提出了新的监管框架,例如《人工智能法案》。

与此同时,我们见证了新型AI威胁的崛起,这使得安全行业的复杂性进一步增加。

组织现在不仅面临防御这些高级威胁的压力,同时也需要利用AI的优势来增强自身的安全程序。如今,AI已经与整个组织系统紧密结合,并且其影响力正在不断扩大,这在公司内部模糊了责任和所有权的界限。早期云计算和SaaS的转型过程有着类似的情景,新安全威胁的出现使得很多组织无法确定责任归属。

这种不确定性促使人们呼吁采用更统一和协作的安全方法,因为保护不断演变的威胁需要集体的努力。AI的快速发展使得这种协作显得更为紧迫,比云计算时代更快的速度要求安全领导者提前思考并采取行动来应对潜在威胁。

勇敢的新世界

对于AI仍有许多未知之处。某行业同仁曾将AI形容为“外星技术”,对此我深有同感。AI模型代表了一种全新的事物,需要全新的教育和思维方式。

尽管许多安全从业者认为AI的基础性质带来了积极的一面,但理解它的复杂性却令人感到困难。我们当下面临三大风险:

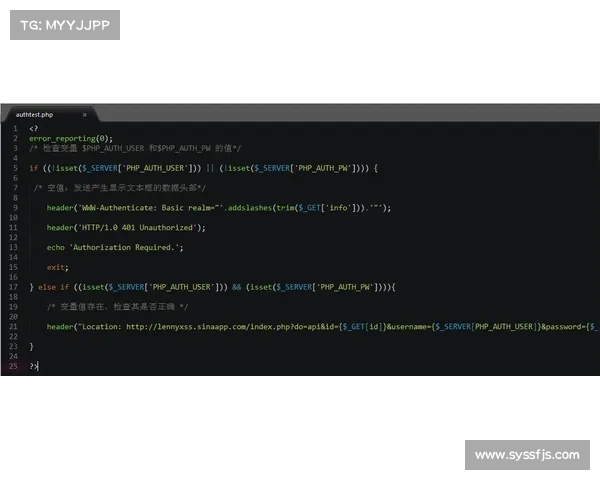

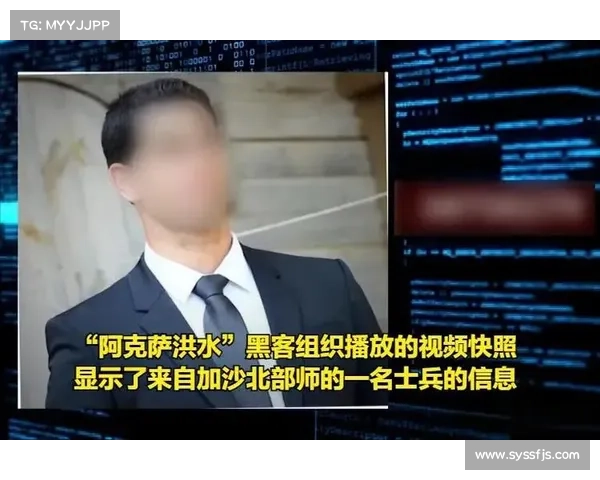

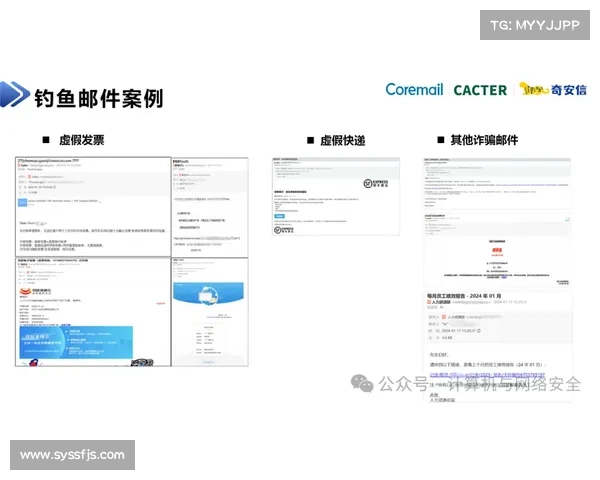

风险类型说明受保护信息的训练AI系统依赖于数据,这些数据往往来自公开源。使用私有信息训练模型时,需要采取不同的方法来保护数据。必须将模型隔离,以确保输入的数据不会被未经授权的人获取。对AI的过度信任AI在日常活动中创造效率,但也可能出错。过度依赖AI而没有适当的控制措施,可能导致严重问题,例如某航空公司的聊天机器人错误地告知客户有关丧亲政策的信息,导致法律后果。恶意对手的AI使用新技术往往吸引恶意对手使用。例如,恶意行为者可能使用AI生成深度伪造内容或虚假信息,并开发复杂的恶意软件或有效的网络钓鱼活动。AI安全需要全员参与

未来,建立跨部门的合作将变得愈加重要,考虑到AI的复杂性和普遍性。组织需对不同的AI相关风险进行管理,某些风险超出了安全范围,对业务的其他部分也有影响。

在各组织中,层级和责任会有所不同且不断演变,但短期内我认为可以从以下几个方面进行发展:

首席信息安全官CISO 负责数据保护,确保数据完整性并防范数据篡改。CISO需与首席法律官CLO紧密合作,以确保模型不违反GDPR或HIPAA等法规。首席法律官CLO 负责版权问题,管理因外部使用技术而产生的相关责任。假设公司因其AI图像识别软件错误分类图像而面临法律审查,这将归属CLO负责。首席产品官CPO或首席技术官CTO 将主管防范恶意内容的威胁,并确保AI系统在处理潜在有害输入时的正确功能和安全性。

首席信息安全官CISO 负责数据保护,确保数据完整性并防范数据篡改。CISO需与首席法律官CLO紧密合作,以确保模型不违反GDPR或HIPAA等法规。首席法律官CLO 负责版权问题,管理因外部使用技术而产生的相关责任。假设公司因其AI图像识别软件错误分类图像而面临法律审查,这将归属CLO负责。首席产品官CPO或首席技术官CTO 将主管防范恶意内容的威胁,并确保AI系统在处理潜在有害输入时的正确功能和安全性。三个行动步骤

首先,我们需要开始思考如何正确地采用AI

xfh5旋风加速官网